Наши услуги

Продвижение сайтов

Продвижение сайтов в Алматы включает в себя оптимизацию сайта в поисковых системах Google и Яндекс. Это два наиболее популярных поисковика в Казнете. Есть еще поиск от Mail.ru, но он работает …

Контекстная реклама

Контекстная реклама в Алматы – это тот инструмент, который даст вам новых покупателей сразу после запуска проекта в работу. Она позволяет закрепить ваш сайт в самом верху списка результатов в …

Обучение SEO

Курсы seo-оптимизации в Алматы для всех желающих предлагает наша компания. Хотите разбираться, почему один сайт в поисковой выдаче стоит выше другого? Научиться поднимать сайты на первые страницы Google

SMM-продвижение

SMM-продвижение в Алматы в наше время ни в коем случае нельзя игнорировать, потому что большинство пользователей интернета до 70% своего времени проводят в социальных сетях. А отказываться от такого масштабного …

Отправьте заявку на бесплатный аудит сайта

Продвижение сайтов в Алматы

Продвижение сайтов в Алматы необходимо каждому бизнесу. Если ваш сайт нацелен на привлечение клиентов, покупателей, заказчиков, посетителей, партнеров и приносит вам выгоду, которая растет вместе с посещаемостью сайта, значит, его нужно продвигать в поисковых системах. Раскрутка сайта в Алматы принесет вашему бизнесу новых клиентов, и вы сможете использовать сайт, как полноценный канал продаж, а не просто красивую картинку в интернете. SEO-продвижение сайта в Алматы положительно влияет и на репутацию компании, ведь больше доверяют бизнесу, чей сайт занимает ведущие позиции.

Конкуренция в интернете растет, и просто создать хороший сайт уже недостаточно, необходимо продвижение сайта в Алматы. Не продвигать сайт вашего бизнеса – это все равно, что создать и распечатать красивый рекламный баннер, повесить его в своем офисе и любоваться целыми днями. Вы его видите, и он вам нравится, но ваши потенциальные клиенты не знают ни о баннере невиданной красоты, ни о вашем бизнесе. То же самое происходит с сайтом без seo-оптимизации.

С каждым днем все больше казахстанцев предпочитают узнавать информацию, покупать товары и услуги, искать подрядчиков, поставщиков и партнеров для своего бизнеса в интернете. И чем позже начнется поисковое продвижение вашего сайта в интернете, тем сложнее ему будет бороться за высокие позиции в поисковых системах. Не откладывайте развитие бизнеса на завтра, ведь клиентов недорого можно получить уже сегодня. Просто позвоните нам, и мы все сделаем в лучшем виде.

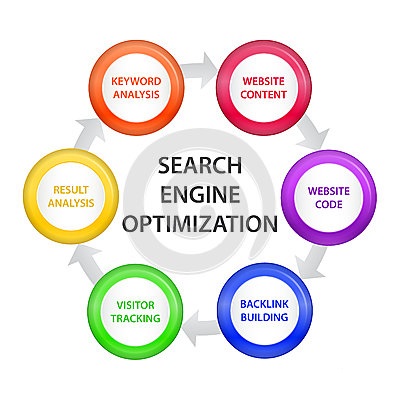

Процесс работы:

Перед началом активных действий по продвижению сайта в поисковых системах, необходимо оценить его текущее состояние. Степень готовности проектов к продвижению всегда разная – у одних имеются базовые настройки внутренней оптимизации, а у других даже элементарных seo-деталей нет. И чтобы правильно направить усилия на развитие сайта, нужно знать его слабые и сильные стороны.

После получения результатов seo-аудита, в первую очередь мы приступаем к работе с внутренней оптимизацией сайта – это исправление ошибок в коде, настройка robots.txt и sitemap, работа с дублями страниц и со страницей 404-ошибки и т.д. После настройки и отладки всех базовых настроек, переходим к активной фазе продвижения.

В каждой тематике есть свои ключевые слова и фразы, по которым люди находят сайты в поисковых системах. Мы подбираем максимально возможное количество ключевых слов для продвижения сайта и распределяем их по страницам, исходя из их популярности и соответствия информации на каждой странице.

Собранные ключевые слова и фразы важно правильно распределить по сайту. Для этого необходимо оптимизировать тексты, с указанием в них ключевых слов, по которым их будут находить пользователи поисковых систем. SEO-копирайтинг – это написание текстов одновременно понятных и легких для восприятия посетителями, и в то же время оптимизированных для поисковых роботов Google и Яндекса. В seo-продвижении качественные тексты играют значительную роль, и могут серьезно влиять на распределение мест в топе поисковой выдачи. Помимо текстового контента, оптимизируются картинки, фотографии и видеоматериалы, размещенные на сайте.

Далее начинается основная, долгая, местами рутинная, а иногда наоборот творческая работа по выведению сайта на высокие позиции в поисковой выдаче. Она включает в себя многие факторы: работа с контентом; постоянное обновление и добавление информации на сайт; работа со ссылочной массой; улучшение юзабилити сайта; улучшение поведенческих факторов и социальных сигналов и многие-многие другие задачи, которые все вместе называются комплексным seo-продвижением сайта.

Хотите, чтобы ваш сайт был в числе первых среди конкурентов и приносил прибыль? Позвоните нам, и мы проведем для вас бесплатную консультацию по seo-продвижению: